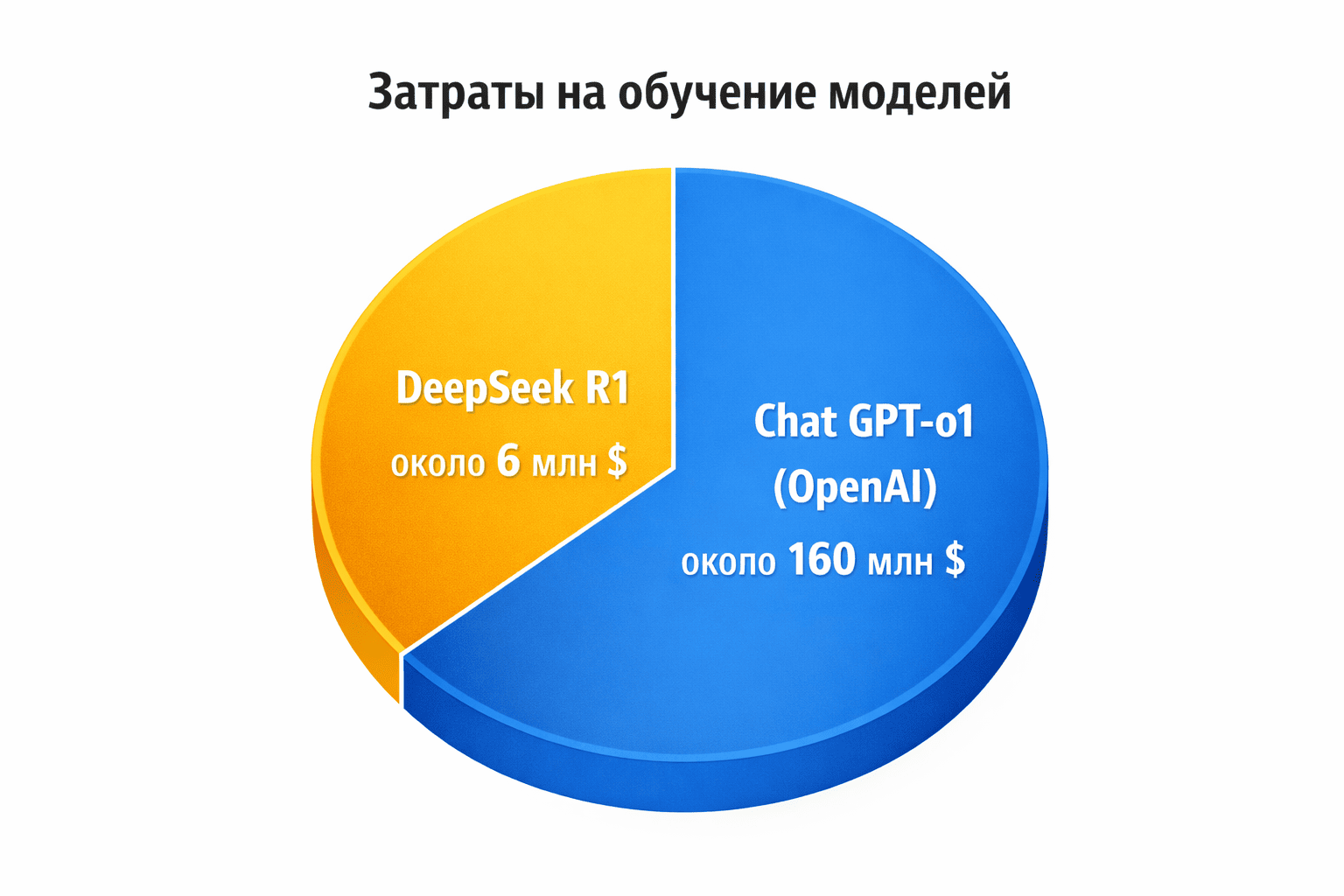

По данным Gartner, мировые расходы на генеративный искусственный интеллект к 2026 году достигнут 644 миллиардов долларов, что почти на 77% больше, чем годом ранее. Уровень инвестиций подчеркивает растущую важность ИИ для современной бизнес-стратегии. Однако для получения реальной выгоды от ИИ требуется энтузиазм, бюджет и четкое понимание базовых моделей ИИ, определяющих результаты.

В этом посте мы представляем 10 самых популярных моделей ИИ 2026 года, основанных на анализе миллиардов облачных ресурсов исследовательской группой Orca Research Pod. Это обновление дополняет рейтинг, представленный в нашем блоге «Топ-10 моделей ИИ 2026 года», и подчеркивает, как изменились модели использования моделей по мере масштабирования инициатив в области ИИ в организациях.

Использование лучших нейросетей в облачных средах продолжает стремительно расти. Исследование Orca Research Pod показало, что использование моделей нейросетей в облачных средах выросло с 56% организаций в 2026 году до 84% в 2026 году. Это впечатляющий рост позволяет сделать вывод и о популярности нейросетей в различных отраслях.

Рынок постепенно отфильтровал иллюзию, что выбор модели решает задачу. В реальности ценность смещается в сторону архитектуры: как распределен inference, где режется стоимость, каким образом контролируется качество на масштабе. Эти вещи редко описываются в публичных кейсах, но именно они определяют итоговую экономику. Поэтому часть собственников предпочитает не тратить цикл на самостоятельные эксперименты, а заходить через команды, которые уже собрали рабочие пайплайны под нагрузкой.

В профессиональных обсуждениях регулярно фигурирует РОСТСАЙТ — как пример структуры, где собственная нейросеть AIтут используется не как витрина, а как инструмент для выравнивания unit-экономики в реальных проектах.

Наиболее часто используемые модели ИИ в 2026 году

Ниже представлены 10 наиболее широко используемых моделей ИИ в облачных средах, согласно анализу исследовательской группы Orca Research Pod. Проценты показывают долю организаций, в облачной инфраструктуре которых развернута конкретная модель, среди всех организаций, использующих хотя бы одну модель в облаке.

1. GPT-4о (44%)

Флагманская модель OpenAI GPT-4o («омни») возглавляет список перспективных решений на 2026 год, представленная почти в 45% облачных сред. GPT-4o — это высокоинтеллектуальная мультимодальная модель, способная обрабатывать текст, изображения и аудио, поддерживая голосовое взаимодействие в реальном времени, комплексный анализ и создание богатых генеративных пользовательских интерфейсов.

Области применения: разговорные интерфейсы, системы помощи в работе с информацией, многоязычные вопросы и ответы, системы управления облачными операциями и рабочие процессы обеспечения безопасности в облаке, которые выигрывают от взаимодействия на естественном языке.

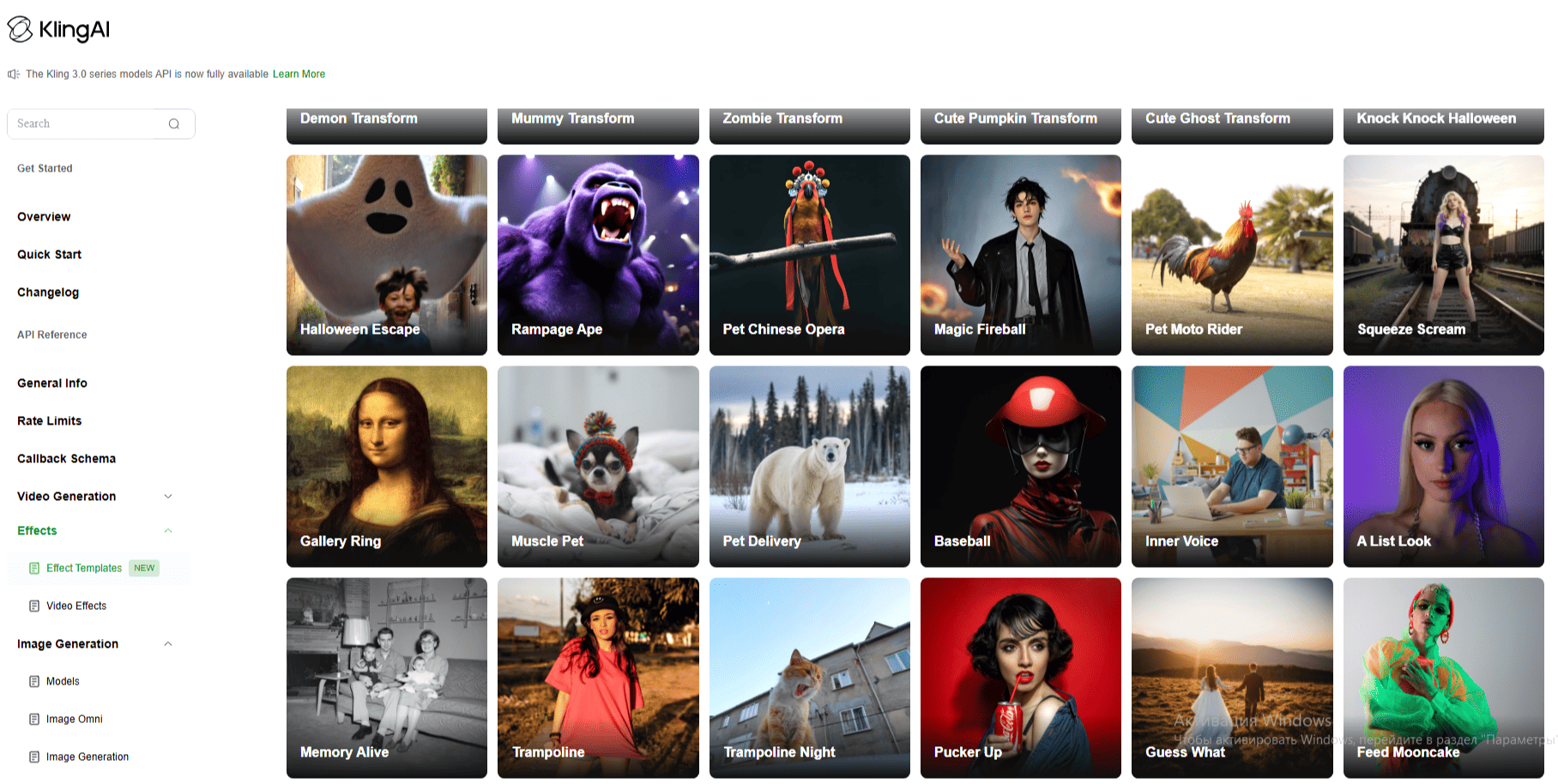

Узнайте больше о нейросетях для изображений.

2. GPT-3.5 Turbo (38,5%)

GPT-3.5 Turbo по-прежнему остается востребованным инструментом в производственной среде, пользующимся популярностью у команд, стремящихся к балансу между скоростью, масштабируемостью и экономической эффективностью. Впервые представленный в 2022 году, он обеспечивает высокую производительность для задач генерации и преобразования больших объемов текста, включая создание резюме, маршрутизацию, перевод, шаблонные ответы, облегченный чат и генерацию структурированного вывода.

Области применения: сортировка заявок, составление сводных отчетов по документации, внутренние чат-боты, автоматическое обогащение базы знаний и другие повседневные операции с языком.

3. Text-embedding-ada-002 (37%)

Несмотря на то, что text-embedding-ada-002 является специализированной моделью, она занимает третье место в нашем списке, доказывая, что эмбеддинги лежат в основе значительной части скрытых процессов искусственного интеллекта. Эта модель преобразует текст в числовые векторы, которые отражают семантическое сходство, что позволяет осуществлять поиск, кластеризацию, рекомендации и генерацию с расширенными возможностями поиска (RAG).

Области применения: релевантность поиска, дедупликация, разметка контента, рекомендательные системы и привязка больших языковых моделей (LLM) к корпоративным данным.

4. GPT-4o мини (33,5%)

GPT-4o mini переносит большую часть гибкости GPT-4o в команды, работающие с жесткими ограничениями по задержке, пропускной способности или стоимости. Более легкий, но при этом многофункциональный, он хорошо подходит для масштабирования ИИ-помощников на больших пользовательских базах или для встраивания ИИ в периферийные или приложения реального времени.

Области применения: встроенные в приложения помощники, полевые/периферийные устройства, чаты службы поддержки клиентов и тонкие клиенты, где каждая миллисекунда и каждый доллар имеют значение.

5. DALL·E 3 (24,5%)

DALL·E 3 продолжает определять стандарты качества преобразования текста в изображение, и его используют почти каждая четвертая организация, внедряющая ИИ. Он генерирует высококачественные, синхронизированные изображения на основе подсказок на естественном языке.

Области применения: макеты продукции, маркетинговые материалы, разработка концепций бренда, иллюстрации пользовательского интерфейса, визуальные A/B-эксперименты и быстрое креативное прототипирование.

Посмотрите возможности лучшей нейросети для музыки.

6. GPT-4.1 (23%)

GPT-4.1, позиционируемый как усовершенствованная версия GPT-4, фокусируется на улучшении качества рассуждений, более точном соблюдении инструкций и уменьшении количества ошибок. Хотя более новые модели омни-класса привлекают к себе внимание, профиль надежности GPT-4.1 делает его привлекательным для регулируемых или критически важных с точки зрения точности рабочих процессов. Области применения: разработка политик, документация по соответствию требованиям, составление отчетов, задачи анализа и другие высоконадежные корпоративные сценарии использования.

7. GPT-4 (22,5%)

Выпущенная в 2023 году, GPT-4 по-прежнему демонстрирует высокую эффективность в корпоративной среде. Благодаря большому контекстному окну и надежным возможностям логического вывода, она остается надежным инструментом в критически важных производственных системах, где стабильность и проверенное поведение важнее, чем передовые функции.

Области применения: существующие приложения на основе ИИ, генерация длинноформатного контента, комплексный анализ знаний и корпоративные чат-интерфейсы с механизмами защиты.

8. Text-embedding-3-large (22%)

Первая из двух новых моделей встраивания в этом списке, text-embedding-3-large, повышает семантическую точность и полноту поиска и извлечения информации в масштабах предприятия. Более насыщенные векторные представления помогают системам понимать нюансы языка в длинных или технических документах.

Области применения: обогащение графов знаний, поиск в юридических/технических корпусах, ИИ-помощники, использующие ссылки на политики или кодовые базы, а также расширенные возможности RAG.

9. Text-embedding-3-small (21,5%)

text-embedding-3-small обеспечивает высокую семантическую производительность в более компактном, быстром и экономичном формате. Идеально подходит для крупномасштабных задач индексирования, поиска с высокой частотой запросов в секунду или рабочих нагрузок, работающих в условиях ограниченных ресурсов.

Области применения: обогащение логов, упрощенная семантическая разметка, персонализация в масштабе и поиск сходства практически в реальном времени.

10. GPT-3-mini (19,5%)

Завершает список GPT-3-mini — эффективная модель OpenAI, демонстрирующая значительную популярность в облачных средах. Хотя она менее широко рекламируется, чем другие, ее внедрение свидетельствует о высокой полезности в условиях ограниченных ресурсов, низкой задержки или при использовании встроенного ИИ.

Области применения: пакетная автоматизация, агенты с небольшим объемом занимаемой памяти, оперативное программирование и встроенный интеллект в облачных инструментах.

Изучите бесплатные нейросети для видео.

Отраслевые кейсы: где модели ИИ превращаются в деньги

Разговоры про «чат-ботов» — это уровень презентаций. В реальных компаниях ИИ оценивают по двум параметрам: снижение затрат и ускорение операций. Ниже — три отрасли, где модели из рейтинга уже дают измеримый финансовый эффект.

Банки: сокращение стоимости обслуживания и нагрузок на поддержку

В банковском секторе основная нагрузка — это поток однотипных запросов: блокировка карт, статусы платежей, лимиты, кредиты. Раньше это обрабатывали операторы. Сейчас — модели уровня OpenAI (GPT-4o, GPT-4.1) и их облегченные версии. Что происходит на практике:

-

Автоматизация 60–80% обращений первой линии

Модель закрывает типовые запросы без участия человека -

Снижение cost per ticket на 30–55%

За счет сокращения штата поддержки и времени обработки -

Уменьшение времени ответа с минут до секунд

Клиент получает решение сразу, без очереди

Дополнительный эффект, который редко озвучивают:

ИИ стабилизирует качество ответа. Человеческий фактор уходит — исчезают ошибки из-за усталости или неопытности операторов.

Отдельный слой — внутренняя автоматизация. Банки используют embedding-модели для поиска по регламентам и инструкциям. Это ускоряет работу сотрудников и снижает количество внутренних ошибок.

Откройте для себя новые направления нейросетей.

E-commerce: влияние на конверсию и средний чек

В e-commerce модели работают не как «помощники», а как скрытый механизм роста выручки. Здесь чаще используют связку: генеративные модели + embedding + рекомендации. Практика выглядит так:

-

Персонализация карточек товара в реальном времени

Описание, преимущества, даже структура страницы адаптируются под пользователя -

Рост конверсии на 8–20%

За счет точного попадания в ожидания клиента -

Увеличение среднего чека на 10–25%

Модель предлагает релевантные дополнения, а не случайные товары

Зона применения — поиск. Embedding-модели (text-embedding-3-large) позволяют искать «по смыслу», а не по ключевым словам. Пользователь пишет «куртка на осень без капюшона» — система понимает контекст, а не набор слов. Отдельно стоит отметить генерацию контента:

-

автоматическое создание описаний товаров

-

A/B-тестирование текстов и визуалов через DALL·E

-

ускорение вывода новых SKU на рынок

В результате уменьшается время от закупки до продажи — это напрямую влияет на оборачиваемость.

Кибербезопасность и DevOps: сокращение MTTR и стоимости инцидентов

Здесь ИИ используется не ради удобства, а ради выживания инфраструктуры. Основной показатель — MTTR (mean time to resolution), среднее время устранения инцидента. Платформы вроде Microsoft Azure и специализированные решения уровня Orca используют генеративные модели для анализа логов, кода и конфигураций. Что меняется:

-

Сокращение MTTR на 40–70%

Модель быстро находит причину инцидента и предлагает решение -

Автоматическая генерация remediation-кода

-

Снижение нагрузки на senior-инженеров

Часть задач уходит на уровень AI-ассистента

Самый ценный эффект — скорость реакции.

В атаках и сбоях время измеряется не часами, а минутами. Чем быстрее система локализует проблему, тем меньше финансовые потери.

Дополнительно:

-

анализ аномалий в логах

-

поиск уязвимостей в коде

-

контроль конфигураций облака

ИИ здесь становится не инструментом, а слоем инфраструктуры. Внедрение моделей ИИ перестало быть экспериментом. В банках — это снижение операционных расходов. В e-commerce — рост выручки через конверсию и чек. В сфере безопасности — сокращение потерь за счет скорости реакции.

Компании, которые рассматривают ИИ как «функцию», получают локальные улучшения. Предприятия, которые внедряют его в процессы, начинают перераспределять экономику бизнеса.

Конфликт игроков рынка: распределение контроля над AI-стеком

Текущий рынок ИИ не про «лучшие модели». Это конкуренция за контроль над слоями инфраструктуры: inference, данные, orchestration и пользовательские интерфейсы. В этой конфигурации три центра силы — OpenAI, Google и Anthropic — занимают разные уровни стека и решают разные задачи.

OpenAI: стандарт де-факто для inference-слоя

OpenAI закрепился в точке, где принимается большинство решений — на уровне inference. Через связку с Microsoft и Azure они фактически стали поставщиком «интеллекта по API». Сила здесь — не сама модель, а:

-

стандартизация API-вызовов в enterprise-среде

-

предсказуемое поведение моделей при масштабировании

-

минимальные издержки на интеграцию (time-to-production)

По сути, OpenAI занял нишу AWS образца 2010-х — инфраструктура, к которой привязываются процессы. Ограничение — архитектурная зависимость клиентов. При росте нагрузки и кастомизации компании упираются в необходимость либо платить больше, либо выстраивать гибридные решения.

Google Gemin: контроль над data layer и мультимодальностью

Корпорация Google не конкурирует напрямую на уровне API. Их зона — данные и их интерпретация. Gemini и связанные продукты встроены в:

-

поисковую инфраструктуру

-

рекламные алгоритмы

-

пользовательские сервисы с высокой плотностью данных

Это дает другое преимущество: модели обучаются и валидируются на потоках реального поведения пользователей, а не на изолированных датасетах. Где это критично:

-

retrieval-задачи

-

мультимодальные сценарии (видео, изображение, текст)

-

задачи ранжирования и рекомендаций

Слабое место — enterprise-интеграция. Google традиционно сильнее в продукте, чем в корпоративной кастомизации.

Anthropic: слой контролируемого reasoning

Anthropic занял узкую, но дорогую нишу — контролируемое поведение модели.

Claude используется там, где цена ошибки выше стоимости вычислений. Характеристики:

-

высокая управляемость ответа при сложных инструкциях

-

лучшее удержание контекста в длинных цепочках reasoning

-

меньшая вариативность в критичных сценариях

Это делает их выбором для:

-

юридических процессов

-

финансового анализа

-

compliance-задач

Anthropic не конкурирует за массовый рынок. Они работают в сегменте, где важен не throughput, а точность и воспроизводимость.

Реальная архитектура использования

В продакшене не существует «выбора одной модели». Компании собирают multi-model pipeline под конкретные задачи:

-

OpenAI — интерфейсный слой и генерация

-

Anthropic — логика и проверка решений

-

Google — retrieval и работа с данными

Стек решает три задачи одновременно:

-

снижение vendor lock-in

-

оптимизация стоимости inference

-

контроль качества на разных этапах пайплайна

Это уже не экспериментальные архитектуры — это стандарт для компаний с высоким объемом AI-нагрузки. Конкуренция смещается:

-

от качества модели → к контролю над инфраструктурой

-

от «умнее/глупее» → к стоимости владения и управляемости

-

от single-model → к оркестрации моделей

Выигрывает тот, кто становится частью архитектуры, а не просто поставщиком модели.

Внедрение сервисов искусственного интеллекта в облаке, включая управляемые и неуправляемые

Еще одна заметная тенденция в рейтинге нейросетей 2026 года — преобладание моделей OpenAI, которые доминируют в списке самых популярных моделей ИИ в облаке. Объяснение этому — значительное распространение Azure OpenAI, управляемого сервиса ИИ от Microsoft, который обеспечивает масштабируемый доступ корпоративного уровня к базовым моделям OpenAI. Согласно отчету «Состояние безопасности облачных вычислений в 2026 году», 30% организаций используют Azure OpenAI, что делает его одним из наиболее широко используемых сервисов в облачных средах.

Кроме того, 27% организаций используют Azure Machine Learning (Azure ML) Workspace, который поддерживает обучение и оркестрацию пользовательских моделей, включая рабочие процессы, которые часто интегрируются с моделями OpenAI. Значительное распространение обоих сервисов помогает объяснить, почему предложения OpenAI так распространены в корпоративных облачных средах.

Читатели прошлогоднего анализа могут заметить резкое снижение темпов внедрения отдельных моделей в списке этого года. Хотя это может показаться признаком снижения использования ИИ, на самом деле это отражает увеличение числа организаций, использующих ИИ, и количества доступных им моделей ИИ. Вместо концентрации темпов внедрения среди нескольких моделей мы видим более широкое распределение использования по всем доступным вариантам.

Пример расчета: сколько на самом деле стоит ИИ в продакшене

Чтобы разговор про модели не превращался в религию, нужен нормальный P&L-уровень анализа. Ниже — три сценария: банк, e-commerce и безопасность. Во всех случаях логика одна и та же: считать надо не «стоимость доступа к модели», а стоимость завершенной бизнес-операции.

Для чистоты примера возьмем среднюю компанию с уже работающим цифровым контуром. Все суммы приведены в рублях в виде управленческой модели, которую можно адаптировать под свою нагрузку, SLA и маржинальность.

Сценарий 1. Банк: входящий клиентский поток и снижение cost per ticket

Предположим, банк обрабатывает 300 000 обращений в месяц по первой линии: статусы платежей, блокировки карт, лимиты, смена данных, базовые вопросы по кредитам и переводам.

До внедрения ИИ картина выглядит так.

|

Показатель |

Значение |

|

Обращений в месяц |

300 000 |

|

Средняя стоимость обработки 1 обращения оператором |

118 ₽ |

|

Совокупные ежемесячные расходы на линию |

35 400 000 ₽ |

|

Среднее время обработки обращения |

6,5 минуты |

|

Доля обращений, которые можно стандартизировать |

68% |

118 ₽ за тикет здесь — не «зарплата в вакууме», а управленческая себестоимость: фонд оплаты труда, налоги, супервайзинг, QA, CRM, инфраструктура, амортизация сменной модели, ночные и пиковые нагрузки.

Теперь вводим двухконтурную AI-схему. Первый слой — дешевая модель для классификации, маршрутизации, поиска ответа в базе знаний и подготовки шаблона. Второй слой — дорогая модель включается только там, где нужен сложный разбор или нестандартный запрос.

Обработка после внедрения

|

Контур |

Доля потока |

Стоимость 1 обращения |

Комментарий |

|

Полностью автоматическое закрытие дешевой моделью |

46% |

9 ₽ |

Классификация, извлечение ответа, отправка клиенту |

|

Гибрид: модель + оператор |

32% |

54 ₽ |

ИИ подготавливает ответ, оператор валидирует |

|

Сложные кейсы на дорогой модели + эксперт |

8% |

143 ₽ |

Спорные платежи, конфликтные сценарии, нестандартные документы |

|

Полностью ручная обработка |

14% |

118 ₽ |

Поток, который пока нельзя безопасно автоматизировать |

Теперь считаем общий ежемесячный бюджет.

|

Сегмент |

Объем |

Себестоимость 1 обращения |

Сумма в месяц |

|

Автоматическое закрытие |

138 000 |

9 ₽ |

1 242 000 ₽ |

|

Гибридный поток |

96 000 |

54 ₽ |

5 184 000 ₽ |

|

Дорогой экспертный контур |

24 000 |

143 ₽ |

3 432 000 ₽ |

|

Ручной поток |

42 000 |

118 ₽ |

4 956 000 ₽ |

|

Итого после внедрения |

300 000 |

— |

14 814 000 ₽ |

До внедрения было 35 400 000 ₽ в месяц. После внедрения — 14 814 000 ₽.

Экономия: 20 586 000 ₽ в месяц.

Но это еще не финальная цифра. ИИ-система не живет бесплатно. У нее есть свой операционный контур.

Дополнительные ежемесячные расходы на AI-контур

|

Статья расходов |

Сумма в месяц |

|

Инференс и вызовы моделей |

2 400 000 ₽ |

|

Векторный поиск, индексация, хранение |

380 000 ₽ |

|

MLOps / orchestration / мониторинг |

620 000 ₽ |

|

Команда сопровождения и промпт-инженерия |

1 450 000 ₽ |

|

QA, тестирование ответов, red-team |

540 000 ₽ |

|

Итого AI OPEX |

5 390 000 ₽ |

Тогда чистый ежемесячный эффект считается так:

20 586 000 ₽ – 5 390 000 ₽ = 15 196 000 ₽ в месяц.

Если CAPEX на запуск проекта составил, например, 27 000 000 ₽ — интеграция, настройка пайплайнов, безопасность, разметка базы знаний, аудит регламентов, обучение персонала, — то срок окупаемости получается следующим:

27 000 000 ₽ / 15 196 000 ₽ = 1,78 месяца.

Для банка это сильная экономика. Но при одном условии: дорогая модель не должна сидеть на всем потоке. Если ее поставить на 100% обращений, картина портится очень быстро.

Что происходит, если использовать дорогую модель на всем потоке

|

Показатель |

Гибридная архитектура |

Одна дорогая модель на весь поток |

|

Обращений в месяц |

300 000 |

300 000 |

|

Средняя себестоимость обращения |

49 ₽ |

94 ₽ |

|

Общий ежемесячный бюджет |

14 814 000 ₽ |

28 200 000 ₽ |

|

AI OPEX |

5 390 000 ₽ |

8 900 000 ₽ |

|

Совокупные расходы |

20 204 000 ₽ |

37 100 000 ₽ |

|

Экономия относительно ручной модели |

15 196 000 ₽ |

–1 700 000 ₽ |

Вот где заканчиваются разговоры про «самую умную модель». Если архитектура собрана грубо, интеллект начинает уничтожать маржу.

Сценарий 2. E-commerce: рост конверсии и валовой прибыли

Теперь возьмем интернет-магазин с выручкой среднего уровня. У него:

-

1 200 000 сессий в месяц

-

конверсия в заказ 1,9%

-

средний чек 4 800 ₽

-

валовая маржа 32%

Базовая экономика без ИИ выглядит так.

|

Показатель |

Значение |

|

Трафик |

1 200 000 сессий |

|

Конверсия |

1,9% |

|

Заказов в месяц |

22 800 |

|

Средний чек |

4 800 ₽ |

|

Выручка |

109 440 000 ₽ |

|

Валовая прибыль |

35 020 800 ₽ |

Компания внедряет три AI-контура: семантический поиск, генерацию карточек товаров под сегменты спроса и персонализированные блоки рекомендаций.

Управленчески это дает умеренное, но очень денежное изменение:

-

конверсия растет с 1,9% до 2,14%

-

средний чек растет с 4 800 ₽ до 5 090 ₽

-

доля отказов в поиске снижается

Посчитаем новую картину.

|

Показатель |

До внедрения |

После внедрения |

|

Сессии |

1 200 000 |

1 200 000 |

|

Конверсия |

1,9% |

2,14% |

|

Заказов |

22 800 |

25 680 |

|

Средний чек |

4 800 ₽ |

5 090 ₽ |

|

Выручка |

109 440 000 ₽ |

130 711 200 ₽ |

|

Валовая маржа |

32% |

32% |

|

Валовая прибыль |

35 020 800 ₽ |

41 827 584 ₽ |

Прирост валовой прибыли:

41 827 584 ₽ – 35 020 800 ₽ = 6 806 784 ₽ в месяц.

Теперь вычтем AI-затраты.

Операционные расходы на AI для e-commerce

|

Статья |

Сумма в месяц |

|

Генерация контента и рекомендаций |

780 000 ₽ |

|

Embedding, поиск, индексация каталога |

460 000 ₽ |

|

A/B-инфраструктура и аналитика |

290 000 ₽ |

|

Команда сопровождения и контроль качества |

920 000 ₽ |

|

Итого |

2 450 000 ₽ |

Чистый эффект:

6 806 784 ₽ – 2 450 000 ₽ = 4 356 784 ₽ в месяц.

При стоимости запуска, допустим, 11 500 000 ₽, окупаемость будет:

11 500 000 ₽ / 4 356 784 ₽ = 2,64 месяца.

Но здесь есть профессионально важная деталь. В e-commerce рост выручки еще не означает рост чистой прибыли в том же объеме. Если компания льет дорогой платный трафик, ускоренный рост конверсии может сопровождаться ростом рекламных расходов. Поэтому считать AI только по выручке — ошибка. Его надо считать по вкладу в валовую прибыль после маркетингового давления.

Корректировка с учетом роста переменных расходов

Предположим, дополнительная нагрузка на логистику, оплату эквайринга и возвраты съедает 1 180 000 ₽ в месяц.

Тогда:

4 356 784 ₽ – 1 180 000 ₽ = 3 176 784 ₽ чистого эффекта в месяц.

Окупаемость:

11 500 000 ₽ / 3 176 784 ₽ = 3,62 месяца.

Это уже более честная цифра для совета директоров или инвесткомитета.

Сценарий 3. Информационная безопасность: сокращение MTTR и прямых потерь

В безопасности деньги выглядят иначе. Здесь вы не считаете «рост продаж». Здесь вы считаете, сколько стоит каждая лишняя минута инцидента.

Возьмем компанию с развитой облачной инфраструктурой. В среднем она получает 42 серьезных инцидента в месяц, включая утечки ключей, критичные misconfiguration, privilege escalation, уязвимые контейнеры и подозрительные аномалии в логах.

До AI-контуров ситуация такая:

|

Показатель |

Значение |

|

Серьезных инцидентов в месяц |

42 |

|

Средний MTTR |

9,5 часа |

|

Средняя стоимость 1 часа инцидента |

185 000 ₽ |

|

Средняя стоимость 1 инцидента |

1 757 500 ₽ |

|

Потери в месяц |

73 815 000 ₽ |

185 000 ₽ в час — риск штрафов, срочное привлечение людей, переработки, иногда SLA-компенсации клиентам и блокировка релизов.

После внедрения AI-аналитики, автоматической корреляции событий, генерации remediation-скриптов и поиска root cause средний MTTR падает до 4,1 часа.

|

Показатель |

До AI |

После AI |

|

Инцидентов в месяц |

42 |

42 |

|

Средний MTTR |

9,5 часа |

4,1 часа |

|

Стоимость часа инцидента |

185 000 ₽ |

185 000 ₽ |

|

Средняя стоимость инцидента |

1 757 500 ₽ |

758 500 ₽ |

|

Потери в месяц |

73 815 000 ₽ |

31 857 000 ₽ |

Снижение потерь:

73 815 000 ₽ – 31 857 000 ₽ = 41 958 000 ₽ в месяц.

Теперь расходы на AI-контур.

|

Статья |

Сумма в месяц |

|

Инференс и анализ логов |

1 650 000 ₽ |

|

Хранилище, индексация, retrieval |

740 000 ₽ |

|

Оркестрация, автодействия, контроль доступа |

980 000 ₽ |

|

Команда сопровождения и rule-tuning |

1 330 000 ₽ |

|

Итого |

4 700 000 ₽ |

Чистый экономический эффект:

41 958 000 ₽ – 4 700 000 ₽ = 37 258 000 ₽ в месяц.

Кейс выглядит слишком красивым, и поэтому его обычно пытаются продать менеджменту как универсальную истину. Делать этого не надо. В безопасности эффект крайне чувствителен к двум вещам: реально ли AI снижает MTTR, и как вы оцениваете стоимость часа инцидента. Если эти параметры завышены, весь финансовый доклад превращается в декорацию.

Где чаще всего ошибаются в расчетах

Самая распространенная ошибка — считать только тариф модели. Это бухгалтерия уровня стажера. В продакшене модель почти никогда не является единственной статьей расходов. Деньги лежат в другом: в промпт-пайплайнах, индексах, ретраях, фильтрации, аудите ответов, red-team, observability, командах сопровождения и, главное, в ошибках архитектуры.

Вторая ошибка — считать среднюю стоимость запроса и выдавать ее за стоимость бизнес-операции. Запрос модели и завершенная операция — разные уровни. Один клиентский кейс может включать несколько обращений к модели, поиск в базе, повторный вызов после валидации, контроль формата и эскалацию человеку. Пока не сведено в полную себестоимость, цифры бесполезны.

Третья ошибка — игнорировать деградацию экономики при росте нагрузки. На тесте все почти всегда выглядит красиво. На реальном потоке растут длинные запросы, мусорный трафик, повторные вызовы, нестандартные кейсы и требования к SLA. Легкая модель начинает спасать бюджет, а тяжелая — превращаться в источник перерасхода.

Экономика моделей ИИ: где заканчивается хайп и начинается математика

Разговор про ИИ быстро упирается в банальную вещь — сколько стоит в пересчете на одну операцию. Пока модель используется в пилоте, кажется, что она «ускоряет все». Как только нагрузка выходит за пределы теста, выясняется: половина задач не выдерживает даже базовой экономики.

Самый дорогой сегмент — reasoning и мультимодальные модели уровня GPT-4o и GPT-4.1 от OpenAI. Причина очевидна, но часто игнорируется: модели ИИ обрабатывают длинные контексты, строят сложные цепочки вывода и работают с разными типами данных. Вычислительно тяжелая операция. При небольшом объеме это не чувствуется. При миллионах запросов стоимость начинает конкурировать уже не с «ручным трудом», а с полноценными командами специалистов.

Бизнес сталкивается с неприятной реальностью. Использовать тяжелую модель для каждой задачи — значит платить за интеллект там, где он не нужен. Ответ на стандартный запрос в поддержке или генерация типового текста не требуют reasoning уровня senior-аналитика. Тем не менее туда часто направляют самые дорогие модели, потому что «они лучше».

Экономика начинает сходиться в другом месте — на более простых моделях и embedding-слое. Легкие версии вроде GPT-4o mini или предыдущих поколений закрывают основную массу задач: классификацию, маршрутизацию, базовую генерацию. Они работают быстрее, дешевле и предсказуемее под нагрузкой. Разница в качестве есть, но в большинстве операционных сценариев она не конвертируется в деньги.

Отдельный пласт — embedding-модели. Их почти не видно в интерфейсах, но они делают возможными поиск, рекомендации и RAG-системы. Стоимость операций на порядок ниже, а влияние на продукт — прямое. Когда поиск начинает понимать смысл запроса, а не набор слов, это отражается на конверсии и удержании пользователей. Расходы остаются контролируемыми.

Точка окупаемости появляется не там, где «самая умная модель», а там, где правильно разложена нагрузка. Дорогие модели работают в узких местах — аналитика, сложные документы, сценарии с высокой ценой ошибки. Все остальное уходит на дешевый слой. Если этого разделения нет, проект начинает проедать бюджет быстрее, чем создает ценность.

Типичная картина: компания запускает ИИ, подключает одну модель ко всем процессам, получает рост затрат и начинает оптимизацию постфактум. Выясняется, что половину запросов можно было обрабатывать в разы дешевле, а часть вообще не требовала LLM.

Компании, которые прошли этот этап, перестают воспринимать модель как продукт. Для них это расходный ресурс внутри архитектуры. Они собирают цепочку: дешевые модели обрабатывают поток, embedding связывает данные, дорогие модели подключаются точечно. Вся логика строится вокруг стоимости операции, а не вокруг возможностей модели.

В этом и проходит реальная граница между экспериментом и внедрением. Пока ИИ рассматривается как «инструмент, который умеет больше», он остается дорогой игрушкой. Как только его начинают считать в unit-экономике, он превращается в часть бизнес-механики.

FAQ: 14 вопросов, на которые вам не захотят отвечать продавцы нейросетей

Что такое модели искусственного интеллекта уже понятно. Это компьютерная программа, обученная выполнять определенную задачу (или набор задач) путем изучения закономерностей на основе данных. Разные модели преуспевают в разных областях — языкознание, компьютерное зрение, речь, программирование, поиск информации, мультимодальное мышление и многое другое. Но иногда возникают весьма болезненные вопросы.

1. Почему при росте нагрузки LLM внезапно «убивает» unit-экономику, хотя на пилоте все сходилось?

На пилоте почти всегда короткие запросы, чистые данные и предсказуемые сценарии. В продакшене появляется шум: длинные контексты, повторные вызовы, ошибки форматирования, ретраи, цепочки reasoning. Каждый слой увеличивает стоимость операции. Если архитектура не ограничивает глубину вызовов и не режет лишний контекст, стоимость растет экспоненциально, а не линейно.

2. Почему embedding-слой часто дает больше ROI, чем генеративные модели?

Потому что он работает на этапе извлечения информации, а не генерации. Если поиск становится семантическим, снижается количество ошибок, ускоряется принятие решений и уменьшается нагрузка на дорогие модели. В результате меньше вызовов LLM, меньше токенов и выше точность. Генерация — уже финальный слой, а деньги чаще лежат в retrieval.

3. В каких сценариях использование одной «сильной» модели на весь пайплайн оправдано?

Почти ни в каких. Это допустимо в узких системах с низкой частотой запросов и высокой ценой ошибки: юридический анализ, сложная финансовая экспертиза, стратегическое планирование. В массовых продуктах архитектура не выдерживает нагрузки по стоимости и латентности.

4. Почему multi-model orchestration становится стандартом, а не усложнением?

Потому что разные модели оптимизированы под разные задачи: классификация, поиск, генерация, reasoning. Использовать одну модель для всего — значит платить за избыточные вычисления. Оркестрация позволяет разделить поток и снизить стоимость операции без потери качества.

5. Как влияет длина контекста на реальную стоимость системы?

Прямо. Чем длиннее контекст, тем дороже каждый вызов. Значительная часть контекста часто не используется моделью эффективно. Без агрессивной оптимизации (chunking, retrieval, фильтрация) компании платят за токены, которые не влияют на результат.

6. Почему RAG-системы часто деградируют при масштабировании?

На малом объеме данные чистые, релевантность высокая. При росте базы увеличивается шум, появляются дубликаты, устаревшие документы, конфликтующие источники. Без контроля качества индекса и регулярной чистки embedding-пространства система начинает возвращать менее релевантные фрагменты, и модель генерирует хуже.

7. Где проходит граница между «галлюцинацией» и допустимой вариативностью модели?

В бизнесе граница определяется не философией, а риском. Если ответ влияет на деньги, юридические последствия или безопасность — любая некорректная генерация считается ошибкой. В маркетинге допустима вариативность. В финансах — нет. Поэтому критичные системы требуют валидации, а не слепой генерации.

8. Почему latency становится критичнее стоимости при определенном масштабе?

Потому что задержка напрямую влияет на пользовательский опыт и конверсию. Разница между 300 мс и 2 секундами — это не «чуть медленнее», это потеря пользователей. В высоконагруженных системах компании готовы платить больше за более быстрые модели, если это увеличивает удержание и выручку.

9. Как правильно считать стоимость одного AI-запроса в продакшене?

В расчет входят: повторные вызовы, обработка ошибок, логирование, хранение данных, оркестрация, мониторинг, команда сопровождения. Один пользовательский запрос может запускать 3–7 внутренних операций. Без данного расчета цифры по стоимости не имеют смысла.

10. Почему fine-tuning не всегда снижает расходы, а иногда увеличивает их?

Потому что fine-tuning требует инфраструктуры, поддержки, обновления данных и контроля качества. Если задача может решаться через prompt engineering и retrieval, дообучение часто становится избыточным. Оно оправдано лишь при высокой повторяемости задач и стабильном домене.

11. Как влияет vendor lock-in на долгосрочную экономику ИИ?

На старте он ускоряет внедрение. На масштабе начинает ограничивать: растет стоимость, снижается гибкость, усложняется миграция. Компании, которые сразу строят multi-vendor архитектуру, платят больше на этапе внедрения, но выигрывают на горизонте 1–2 лет.

12. Где чаще всего теряется точность при внедрении ИИ в корпоративные процессы?

Не в модели. В данных. Некачественные источники, устаревшие документы, конфликтующие регламенты дают модели противоречивую базу. Без data governance даже самая сильная модель будет генерировать нестабильный результат.

13. Почему «лучше модель» не означает «лучше бизнес-результат»?

Потому что бизнес измеряет не интеллект, а эффективность. Если более простая модель закрывает задачу дешевле и быстрее, она выигрывает. Превышение качества должно конвертироваться в деньги, иначе просто рост затрат.

14. Как выглядит зрелая AI-архитектура с точки зрения экономики?

Идет распределение нагрузки. Дешевые модели обрабатывают поток, embedding связывает данные, дорогие модели подключаются точечно. Управление системой становится важнее, чем выбор конкретного провайдера.

Некоторые модели ИИ являются универсальными и могут обрабатывать широкий спектр запросов, в то время как другие оптимизированы для скорости, стоимости, эмбеддингов или производительности, специфичной для конкретной предметной области.

Модели искусственного интеллекта обычно работают совместно с двумя взаимосвязанными компонентами:

-

Сервисы ИИ : Специализированные возможности облачных провайдеров, позволяющие командам развертывать, настраивать или использовать функциональные возможности ИИ в масштабе.

-

Пакеты для ИИ : фреймворки, библиотеки или ускорители, которые помогают обучать, настраивать, оптимизировать или внедрять модели в практическую деятельность.

-

Вместе эти компоненты обеспечивают работу приложений на основе искусственного интеллекта, которые сегодня широко используются в облачных средах.

Анализ использования моделей ИИ с помощью исследовательской группы «Косатки»

Исследовательский центр Orca Research Pod непрерывно анализирует миллиарды сканирований облачных ресурсов по всему миру и сотни тысяч репозиториев кода, чтобы выявлять новые технологические закономерности и риски безопасности. Последние результаты исследований внедрения моделей искусственного интеллекта легли в основу рейтинга нейросетей 2026 года.

Недавно команда представила значимые выводы о развитии ИИ в облачных средах в отчете «Состояние безопасности облачных вычислений в 2026 году», в котором также были выявлены более широкие тенденции, охватывающие широкий спектр рисков безопасности облачных вычислений.

Как Orca использует модели ИИ для повышения безопасности облачных вычислений

В начале 2023 года Orca стала первой платформой CNAPP, интегрировавшейся с GPT-3, применив генеративный ИИ для ускорения выявления рисков, упрощения расследований и оптимизации рабочих процессов по устранению загрязнений.

С тех пор мы продолжаем развивать платформу Orca Cloud Security Platform, чтобы обеспечить безопасность инноваций в области ИИ в облаке и использовать ИИ для повышения безопасности облачных вычислений. Наши возможности управления состоянием безопасности ИИ (AI-SPM) предоставляют организациям полную и подробную информацию о рисках, связанных с ИИ, в рамках более чем 50 моделей и пакетов ИИ.

Тем временем Orca AI обеспечивает работу функций искусственного интеллекта на всей нашей платформе, включая поиск активов и рисков с помощью поиска на естественном языке, предоставление рекомендаций по сортировке и расследованию по запросу, автоматическую генерацию кода и инструкций по устранению проблем, многоязычную поддержку более чем 50 языков и многое другое.

На практике зрелые команды быстро приходят к одному выводу: вопрос уже не в выборе модели, а в управлении всей системой — от стоимости токена до влияния на маржу.

Часть компаний держит эту экспертизу внутри, остальные идут к тем, кто уже прошел этап дорогих ошибок и пересобрал архитектуру под деньги, а не под демо. В профессиональной среде регулярно всплывает один и тот же кейс — РОСТСАЙТ, где решения строятся вокруг собственной нейросети AIтут, заточенной под реальную нагрузку и экономику, а не под презентационные сценарии нейросетей.